Může být umělá inteligence zachráncem lidstva, nebo je naopak obrovskou překážkou při průzkumu vesmíru? To je dilema, kterému vědci čelí. „Obávám se, že umělá inteligence by mohla člověka zcela nahradit,“ varoval Stephen Hawking, teoretický fyzik a astronom.

„Náš svět je stále více utvářen umělou inteligencí (AI) a její moc pronikla už do několika odvětví. Pomáhá například s vědeckými výzkumy, řízením aut a zasahuje už i do hudebního světa,“ píše Branimir Vorška pro web Zimo.

Časopis Acta Astronautica nedávno publikoval článek navrhující novou perspektivu. Podle něj by mohl posun od umělé inteligence po superinteligenci vést k nepolapitelnému „Velkému filtru“. Tuto myšlenku vymyslel Michael Garrett, učitel fyziky a astronomie na univerzitě v Manchesteru. Podle Garretta je nutná regulace umělé inteligence, aby nedocházelo k existenčním hrozbám.

Velký filtr jako největší problém

Velký filtr je předpokládaná situace bránící inteligentnímu životu, aby byl mezihvězdný a meziplanetární. Velký filtr by dokonce mohl vést k zániku inteligentního života. Podle Garretta bude civilizace nejistá, pokud se nevytvoří stabilní a multiplanetární existence.

Některé technologické druhy se nemohou stát multiplanetárními, protože jim brání Velký filtr. Když má druh jen jeden domov, existuje větší riziko jeho vyhynutí. „Předpokládá se, že takový filtr se objeví dříve, než si tyto civilizace mohou vyvinout stabilní a multiplanetární existenci. To naznačuje, že dlouhověkost technické civilizace je menší než 200 let,“ dodává Michael Garrett.

Pokud je celá tato myšlenka pravdivá, může to být důvod, proč nemůžeme detekovat žádné důkazy o mimozemské inteligenci. V případě, že opravdu čelíme omezení na 200 let kvůli superinteligenci, znamená to, že „potřebujeme rychle vytvořit regulační rámce pro rozvoj umělé inteligence na Zemi a rozvoj multiplanetární společnosti, aby se zmírnily takové existenční hrozby,“ vysvětluje Garrett.

Podle některých vědců jsme blízko k obrovské transformaci. „Zdá se, že je umělá inteligence připravená likvidovat pracovní místa pro miliony lidí. Ve spojení s robotikou se transformace zdá být téměř neomezená,“ píše Evan Gough pro Universe today.

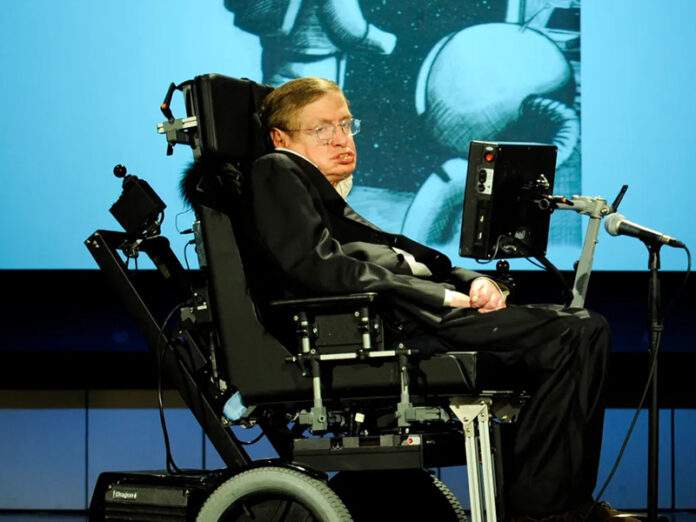

Stephen Hawking měl jasno

V reakci na tyto obavy se vyjádřil zesnulý teoretický fyzik a kosmolog Stephen Hawking. „Obávám se, že umělá inteligence může člověka úplně nahradit. Pokud lidé navrhují počítačové viry, někdo navrhne umělou inteligenci, která se sama vylepšuje a replikuje. Bude to nová forma života, která překoná lidi,“ řekl v roce 2017 pro časopis Wired.

„Musíme pokročit ve vývoji umělé inteligence, ale musíme mít na paměti i její reálná nebezpečí,“ vysvětluje Hawking.

Teoretický fyzik se vyjádřil také k tomu, jak lidé vnímají vědce a vědu. „Lidé nedůvěřují vědě, protože nechápou, jak funguje. Zdá se, jako bychom nyní žili v době, kdy vědě a vědcům hrozí, že budou mít nízkou a klesající úctu. To by mohlo mít vážné následky,“ strachoval se.

„Nejsem si jistý, proč by tomu tak mělo být, když je naše společnost stále více řízena vědou a technikou, ale zdá se, že stále méně mladých lidí se chce věnovat vědě jako kariéře. Jednou z odpovědí by mohlo být vyhlášení nového a ambiciózního kosmického programu, který by je nadchl a podnítil zájem o další oblasti, jako je astrofyzika a kosmologie,“ navrhl tehdy Hawking.

Stephen Hawking byl jednou z nejznámějších osobností, které upozorňovaly na umělou inteligenci. Není však jediný. „Média jsou plná diskuzí a varování. Nejvíce znepokojivá tvrzení říkají, že by se superinteligence mohla zvrtnout,“ uvádí dále Universe Today.

„Obavy z toho, že se umělá inteligence nakonec zvrtne, jsou považovány za hlavní problém. Boj s touto možností v příštích několika letech je rostoucí významnou snahou lídrů v této oblasti,“ uvádí Michael Garrett.

Autor: Nikola Strnadová.